AIへのサイバー攻撃が増えており、AIセキュリティの重要性も増しています。

AIの活用が進む一方で、AIに対するサイバー攻撃も増えており、AIセキュリティの重要性も増しています。

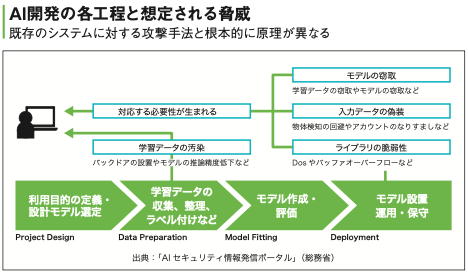

そもそも、AIに対するサイバー攻撃の手法は、ハッカーがAIシステムにバックドアを設置したり、学習データに誤ったデータを紛れ込ませたりなど、既存のITシステムに対する攻撃手法と根本的に原理が異なるものが多く、従来のセキュリティ技術のみで対策することは困難です。

そのため、AI開発の各フェーズでセキュリティを考慮する必要があるのです。

総務省は、AIセキュリティ・マトリックスを提供しています。

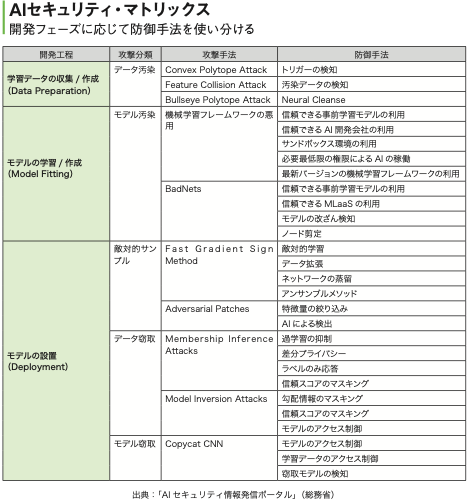

総務省が提供する「AIセキュリティ情報発信ポータル」では、AIに対する攻撃手法と防御手法をAI開発の各工程に合わせて体系化したAIセキュリティ・マトリックスを提供しています。

同フレームワークによれば、学習データの収集・作成段階ではデータ汚染を防ぐためにトリガーや汚染データを検知し、モデルの学習・作成フェーズではモデル汚染を防ぐため信頼できる学習モデルの利用や必要最小限の権限でのAIの稼働などを実施することが求められます。

そしてモデルの設置フェーズでは、敵対的サンプルやデータの窃取を防ぐために敵対的学習や特徴量の絞り込みなどを行うことになります。